| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

Tags

- Folium

- Slicing

- 통계학

- maplotlib

- 자료구조

- 문제풀이

- DataFrame

- 스터디노트

- 재귀함수

- 순열

- matplotlib

- 등차수열

- 리스트

- pandas filter

- Machine Learning

- 파이썬

- python

- INSERT

- MacOS

- 등비수열

- pandas 메소드

- SQL

- 기계학습

- plt

- tree.fit

- barh

- 조합

- pandas

- numpy

- 머신러닝

Archives

- Today

- Total

코딩하는 타코야끼

[스터디 노트] Week10_3일차 [기본] - 통계학 본문

728x90

반응형

1. 모집단과 표본

📍 모집단(Population), 표본(Sample)

⚡️표본추출(Sampling)

- 모집단으로 부터 표본을 추출 하는 것을 Sampling이라고 하며, 표본으로부터 그 특성을 찾아내고 모집단의 특성을 추론하고자 함

- 모집단에서 표본을 추출하는 방법에는 여러가지가 있음

⚡️ 복원추출(Sampling with replacement)

- 모집단에서 데이터를 추출 할 때 하나를 추출하고 다시 넣고 추출하는 방법으로 동일한 표본이 추출 될 수 있음

⚡️ 비복원추출(Sampling without replacement)

- 모집단에서 데이터를 추출 할 때 하나를 추출하고 다시 넣지 않고 추출하는 방법

⚡️Random Sampling

- 모집단에서 데이터를 추출할 때 주의할 점은 편향되지 않아야 함, 각 개체가 모두 동일한 확률로 추출하는 방법

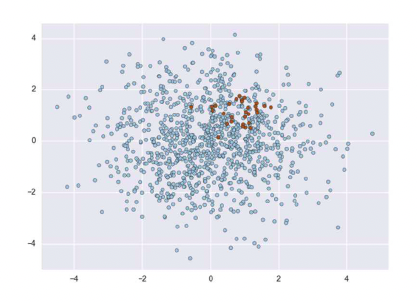

📍 불균형 데이터(Imbalanced Data)의 문제

- 데이터가 불균형 데이터 일 경우 문제가 생김

- 우리가 예측모형을 만드는 목적은 관심이 있는 대상이 발생할 확률을 예측하는 경우가 대부분임, 그런데 예측 대상이 전체 대비 아주 낮다면?

- 모형의 성능이 괜찮을가? (ex: 신용 평가 모형 개발, 제조 불량 예측 등)

- Sampling 기법을 통하여 해결

- 모델을 통한 성능 개선(ex: Cost-sensitive learning)

📍 Sampling 기법

- 관심의 대상의 아주 비율이 낮은 경우

⚡️ Over Sampling

- 타겟 데이터 적은 class의 수를 많은 class의 비율만큼 증가 시킴(일정 비율로 복원추출 하는 개념)

- 과도적합의 문제 발생할 수 있음

⚡️ Under sampling

- 타겟 데이터의 많은 class의 수를 적은 class의 비율만큼 감소 시킴

- 임의로 뽑은 데이터가 biased(편향)될 수 있고, 모형의 성능이 떨어질 수 있음

2. 표본 분포

📍 통계량(Statistic)

- 표본에 기초하여 계산되는 수치 함수를 통계량이라고 함

📍 표본분포(Sampling distribution

- 통계량들이 이루는 분포를 표본 분포라고 함

⚡️ 표본 평균(Sample mean)

⚡️ 표본 평균 의 기대값?

⚡️ 표본 평균 의 분산?

📍 중심극한 정리(central limit theorem)

- 평균이 u 이고 (시그마 제곱) 인 임의의 모집단에서 랜덤 표본 X1, X2, X3, Xn… 을 추출할 때 표본의 크기 n이 충분히( n ≥ SH) 크면,

📍 카이제곱 분포(Chi-square distribution)

📍 자유도(degree of freedom)

- 표본수-제약조건의 수 또는 표본수-추정해야 하는 모수의 수를 의미하며 일반적으로 n-1을 사용함

- 예시적으로 설명 드리면 표본의 크기가 5이고, 표본 평균이 3로 정해졌다면, 숫자 4개는 자유롭게 정할 수 있으나 마지막 하나의 숫자는 나머지 네 개의 숫자에 의해 결정. 1, 2, 3, 4를 골랐다면 마지막 숫자는 자동으로 5가 되야 평균이 5로 정해져 있음

- 카이제곱 분포는 자유도 v의 크기에 따라 모양이 달라짐 자유도가 커질수록 분포가 좌우 대칭 형태로 됨

- 카이제곱 분포는 자유도가 커지면서 표준정규 분포에 근사하며, m ≥ SH이면, 확률을 근사적으로 정규분포로 구할 수 있음

📍 T분포(t-distribution)

📍 F분포(F distribution)

3. 추정

📍 추정(estimation)

- 모집단의 모수를 모를 경우 표본으로 추출된 통계량을 모집단의 근사값으로 사용하는 것을 추정이라고

📍 추정량(estimator)

- 표본 평균으로 모평균을 추정할 때 표본 평균을 모평균에 대한 추정량이라고 함

- 모수를 추정 하는 방법에는 점추정(point estimation) 과 구간 추정(interval estimation)이 있음

- 점추정: 모수를 하나의 특정값으로 추정 하는 방법

- 구간 추정: 모수가 포함될 수 있는 구간을 추정하는 방법

📍 점추정(point estimation)

⚡️ 일치성(Consistency)

- 표본의 크기가 모집단의 크기에 근접해야 함

- 표본이 크기가 크면 클수록(모집단에 가까울 수록) 추정량의 오차가 작아짐

⚡️ 불편성(unbiased estimator)

- 추정량이 모수와 같아야 함

⚡️ 유효성(efficiency)

- 추정량의 분산이 최소값이어야 함

⚡️ 평균오차제곱(Mean Squared Error, MSE)

- 평균오차제곱이 최소값이어야 함

📍 구간 추정(interval estimation)

4. 모비율 추정

📍 모비율의 점추정

📍 모비율의 구간 추정

📍 모비율의 표본 크기

📍 모평균 차이의 추정(점추정)

⚡️ 모평균 차이의 추정(구간추정: 대표본)

⚡️ 모평균 차이의 추정(구간추정: 소표본, 모분산을 모르는 경우)

📍 모비율 차이의 추정(점추정)

⚡️ 모비율 차이의 추정(구간추정)

반응형

'zero-base 데이터 취업 스쿨 > 스터디 노트' 카테고리의 다른 글

| [스터디 노트] Week12_2일차 [4 ~ 5] - ML (1) | 2023.10.11 |

|---|---|

| [스터디 노트] Week12_1일차 [1 ~ 3] - ML (1) | 2023.10.10 |

| [스터디 노트] Week10_2일차 [기본] - 통계학 (0) | 2023.09.11 |

| [스터디 노트] Week10_1일차 [기본] - 통계학 (2) | 2023.09.11 |

| [스터디 노트] Week9_4일차 [심화_8 ~ 10] - SQL (0) | 2023.09.04 |